Update README.md

Browse files

README.md

CHANGED

|

@@ -23,16 +23,6 @@ GLM-4-9B 是智谱 AI 推出的最新一代预训练模型 GLM-4 系列中的开

|

|

| 23 |

|

| 24 |

## 评测结果

|

| 25 |

|

| 26 |

-

我们在一些经典任务上对 GLM-4-9B-Chat 模型进行了评测,并得到了如下的结果:

|

| 27 |

-

|

| 28 |

-

|

| 29 |

-

| Model | AlignBench-v2 | MT-Bench | IFEval | MMLU | C-Eval | GSM8K | MATH | HumanEval | NCB |

|

| 30 |

-

|:--------------------|:-------------:|:--------:|:------:|:----:|:------:|:-----:|:----:|:---------:|:----:|

|

| 31 |

-

| Llama-3-8B-Instruct | 5.12 | 8.00 | 68.58 | 68.4 | 51.3 | 79.6 | 30.0 | 62.2 | 24.7 |

|

| 32 |

-

| ChatGLM3-6B | 3.97 | 5.50 | 28.1 | 66.4 | 69.0 | 72.3 | 25.7 | 58.5 | 11.3 |

|

| 33 |

-

| GLM-4-9B-Chat | 6.61 | 8.35 | 69.0 | 72.4 | 75.6 | 79.6 | 50.6 | 71.8 | 32.2 |

|

| 34 |

-

|

| 35 |

-

|

| 36 |

### 长文本

|

| 37 |

|

| 38 |

在 1M 的上下文长度下进行[大海捞针实验](https://github.com/LargeWorldModel/LWM/blob/main/scripts/eval_needle.py),结果如下:

|

|

@@ -43,32 +33,6 @@ GLM-4-9B 是智谱 AI 推出的最新一代预训练模型 GLM-4 系列中的开

|

|

| 43 |

|

| 44 |

|

| 45 |

|

| 46 |

-

### 多语言能力

|

| 47 |

-

|

| 48 |

-

在六个多语言数据集上对 GLM-4-9B-Chat 和 Llama-3-8B-Instruct 进行了测试,测试结果及数据集对应选取语言如下表

|

| 49 |

-

|

| 50 |

-

| Dataset | Llama-3-8B-Instruct | GLM-4-9B-Chat | Languages

|

| 51 |

-

|:------------|:-------------------:|:-------------:|:----------------------------------------------------------------------------------------------:|

|

| 52 |

-

| M-MMLU | 49.6 | 56.6 | all

|

| 53 |

-

| FLORES | 25.0 | 28.8 | ru, es, de, fr, it, pt, pl, ja, nl, ar, tr, cs, vi, fa, hu, el, ro, sv, uk, fi, ko, da, bg, no

|

| 54 |

-

| MGSM | 54.0 | 65.3 | zh, en, bn, de, es, fr, ja, ru, sw, te, th

|

| 55 |

-

| XWinograd | 61.7 | 73.1 | zh, en, fr, jp, ru, pt

|

| 56 |

-

| XStoryCloze | 84.7 | 90.7 | zh, en, ar, es, eu, hi, id, my, ru, sw, te

|

| 57 |

-

| XCOPA | 73.3 | 80.1 | zh, et, ht, id, it, qu, sw, ta, th, tr, vi

|

| 58 |

-

|

| 59 |

-

|

| 60 |

-

|

| 61 |

-

### 工具调用能力

|

| 62 |

-

|

| 63 |

-

我们在 [Berkeley Function Calling Leaderboard](https://github.com/ShishirPatil/gorilla/tree/main/berkeley-function-call-leaderboard)上进行了测试并得到了以下结果:

|

| 64 |

-

|

| 65 |

-

| Model | Overall Acc. | AST Summary | Exec Summary | Relevance |

|

| 66 |

-

|:-----------------------|:------------:|:-----------:|:------------:|:---------:|

|

| 67 |

-

| Llama-3-8B-Instruct | 58.88 | 59.25 | 70.01 | 45.83 |

|

| 68 |

-

| gpt-4-turbo-2024-04-09 | 81.24 | 82.14 | 78.61 | 88.75 |

|

| 69 |

-

| ChatGLM3-6B | 57.88 | 62.18 | 69.78 | 5.42 |

|

| 70 |

-

| GLM-4-9B-Chat | 81.00 | 80.26 | 84.40 | 87.92 |

|

| 71 |

-

|

| 72 |

**本仓库是 GLM-4-9B-Chat-1M 的模型仓库,支持`1M`上下文长度。**

|

| 73 |

|

| 74 |

## 运行模型

|

|

@@ -94,7 +58,7 @@ inputs = tokenizer.apply_chat_template([{"role": "user", "content": query}],

|

|

| 94 |

|

| 95 |

inputs = inputs.to(device)

|

| 96 |

model = AutoModelForCausalLM.from_pretrained(

|

| 97 |

-

"THUDM/glm-4-9b-chat",

|

| 98 |

torch_dtype=torch.bfloat16,

|

| 99 |

low_cpu_mem_usage=True,

|

| 100 |

trust_remote_code=True

|

|

|

|

| 23 |

|

| 24 |

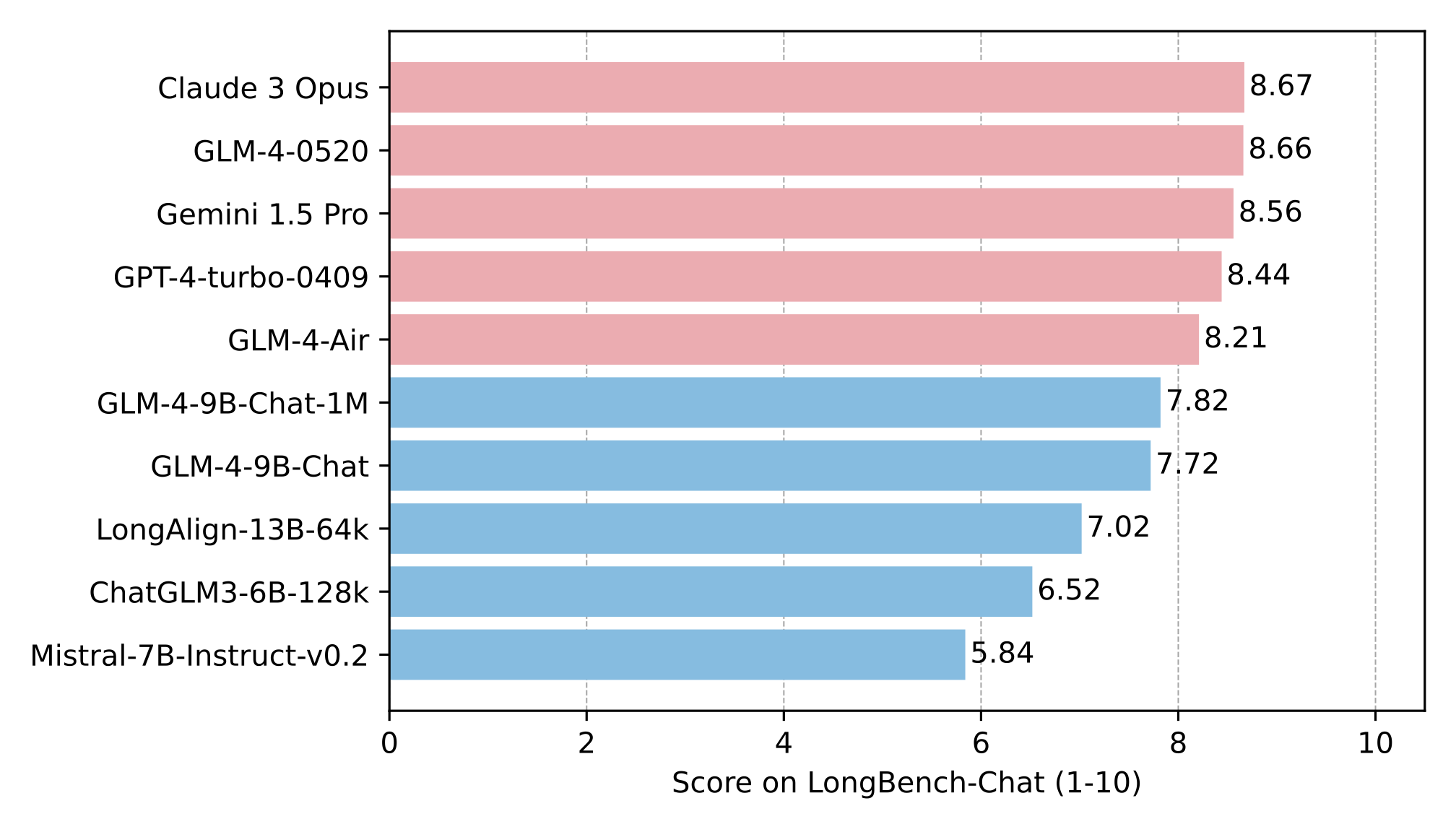

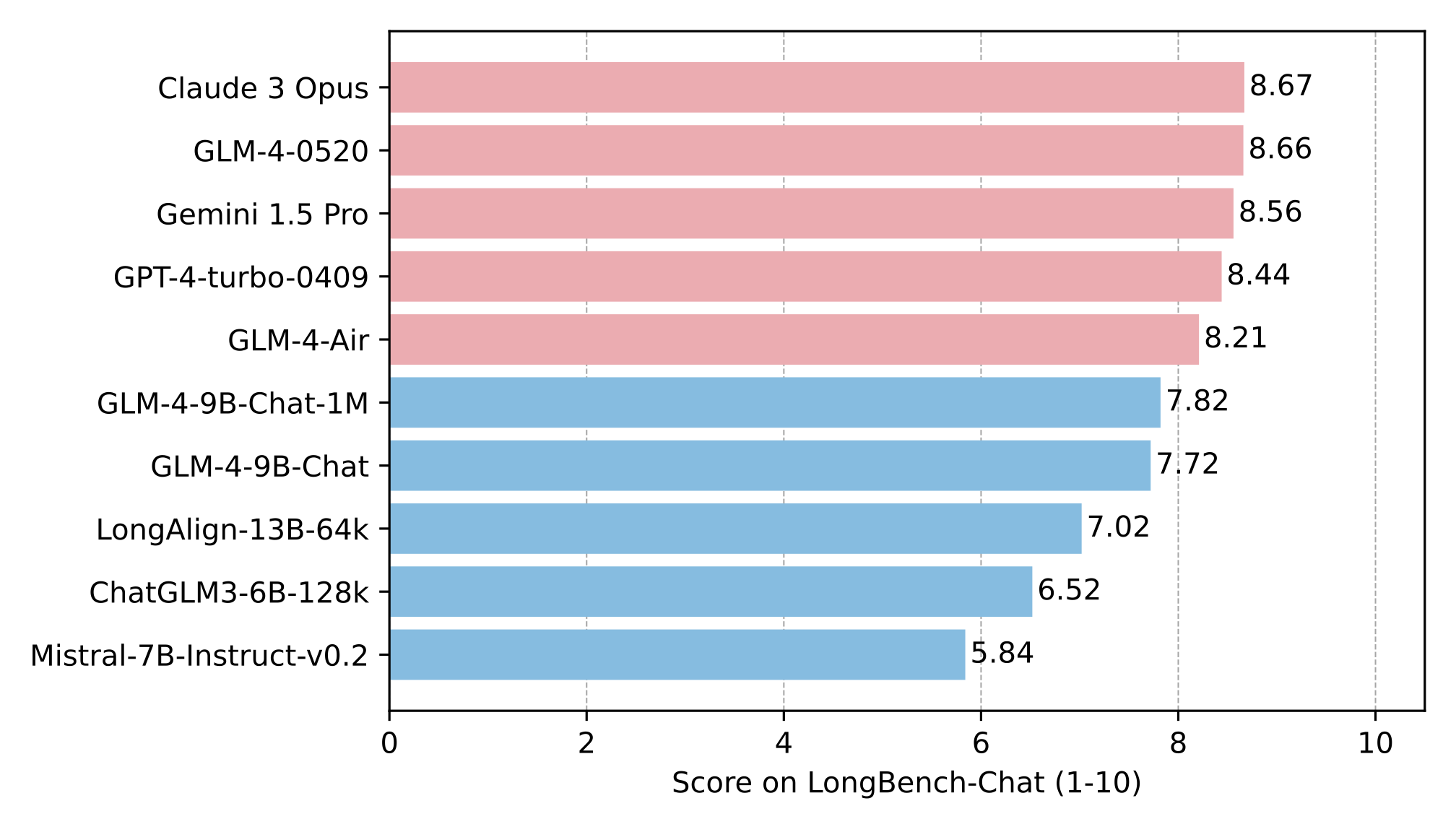

## 评测结果

|

| 25 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 26 |

### 长文本

|

| 27 |

|

| 28 |

在 1M 的上下文长度下进行[大海捞针实验](https://github.com/LargeWorldModel/LWM/blob/main/scripts/eval_needle.py),结果如下:

|

|

|

|

| 33 |

|

| 34 |

|

| 35 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 36 |

**本仓库是 GLM-4-9B-Chat-1M 的模型仓库,支持`1M`上下文长度。**

|

| 37 |

|

| 38 |

## 运行模型

|

|

|

|

| 58 |

|

| 59 |

inputs = inputs.to(device)

|

| 60 |

model = AutoModelForCausalLM.from_pretrained(

|

| 61 |

+

"THUDM/glm-4-9b-chat-1m",

|

| 62 |

torch_dtype=torch.bfloat16,

|

| 63 |

low_cpu_mem_usage=True,

|

| 64 |

trust_remote_code=True

|