Delete docs

Browse files- docs/cn/README.cn.md +0 -198

- docs/cn/faq.md +0 -150

- docs/en/faiss_tips_en.md +0 -102

- docs/en/faq_en.md +0 -114

- docs/en/training_tips_en.md +0 -65

- docs/fr/README.fr.md +0 -166

- docs/fr/faiss_tips_fr.md +0 -105

- docs/fr/faq_fr.md +0 -164

- docs/fr/training_tips_fr.md +0 -65

- docs/jp/README.ja.md +0 -203

- docs/jp/faiss_tips_ja.md +0 -101

- docs/jp/faq_ja.md +0 -117

- docs/jp/training_tips_ja.md +0 -64

- docs/kr/README.ko.han.md +0 -100

- docs/kr/README.ko.md +0 -359

- docs/kr/faiss_tips_ko.md +0 -132

- docs/kr/faq_ko.md +0 -125

- docs/kr/training_tips_ko.md +0 -53

- docs/pt/README.pt.md +0 -180

- docs/pt/faiss_tips_pt.md +0 -102

- docs/pt/faq_pt.md +0 -220

- docs/pt/training_tips_pt.md +0 -65

- docs/tr/README.tr.md +0 -141

- docs/tr/faiss_tips_tr.md +0 -104

- docs/tr/faq_tr.md +0 -98

- docs/tr/training_tips_tr.md +0 -64

docs/cn/README.cn.md

DELETED

|

@@ -1,198 +0,0 @@

|

|

| 1 |

-

<div align="center">

|

| 2 |

-

|

| 3 |

-

# Retrieval-based-Voice-Conversion-WebUI

|

| 4 |

-

一个基于VITS的简单易用的变声框架<br><br>

|

| 5 |

-

|

| 6 |

-

[](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI)

|

| 8 |

-

|

| 9 |

-

|

| 10 |

-

|

| 11 |

-

[](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/blob/main/LICENSE)

|

| 12 |

-

[](https://huggingface.co/lj1995/VoiceConversionWebUI/tree/main/)

|

| 13 |

-

|

| 14 |

-

[](https://discord.gg/HcsmBBGyVk)

|

| 15 |

-

|

| 16 |

-

[**常见问题解答**](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/wiki/%E5%B8%B8%E8%A7%81%E9%97%AE%E9%A2%98%E8%A7%A3%E7%AD%94) | [**AutoDL·5毛钱训练AI歌手**](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/wiki/Autodl%E8%AE%AD%E7%BB%83RVC%C2%B7AI%E6%AD%8C%E6%89%8B%E6%95%99%E7%A8%8B) | [**对照实验记录**](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/wiki/Autodl%E8%AE%AD%E7%BB%83RVC%C2%B7AI%E6%AD%8C%E6%89%8B%E6%95%99%E7%A8%8B](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/wiki/%E5%AF%B9%E7%85%A7%E5%AE%9E%E9%AA%8C%C2%B7%E5%AE%9E%E9%AA%8C%E8%AE%B0%E5%BD%95)) | [**在线演示**](https://modelscope.cn/studios/FlowerCry/RVCv2demo)

|

| 17 |

-

|

| 18 |

-

[**English**](../../README.md) | [**中文简体**](../cn/README.cn.md) | [**日本語**](../jp/README.ja.md) | [**한국어**](../kr/README.ko.md) ([**韓國語**](../kr/README.ko.han.md)) | [**Français**](../fr/README.fr.md) | [**Türkçe**](../tr/README.tr.md) | [**Português**](../pt/README.pt.md)

|

| 19 |

-

|

| 20 |

-

</div>

|

| 21 |

-

|

| 22 |

-

> 底模使用接近50小时的开源高质量VCTK训练集训练,无版权方面的顾虑,请大家放心使用

|

| 23 |

-

|

| 24 |

-

> 请期待RVCv3的底模,参数更大,数据集更大,效果更好,基本持平的推理速度,需要训练数据量更少。

|

| 25 |

-

|

| 26 |

-

> 由于某些地区无法直连Hugging Face,即使设法成功访问,速度也十分缓慢,特推出模型/整合包/工具的一键下载器,欢迎试用:[RVC-Models-Downloader](https://github.com/fumiama/RVC-Models-Downloader)

|

| 27 |

-

|

| 28 |

-

| 训练推理界面 |

|

| 29 |

-

| :--------: |

|

| 30 |

-

|  |

|

| 31 |

-

|

| 32 |

-

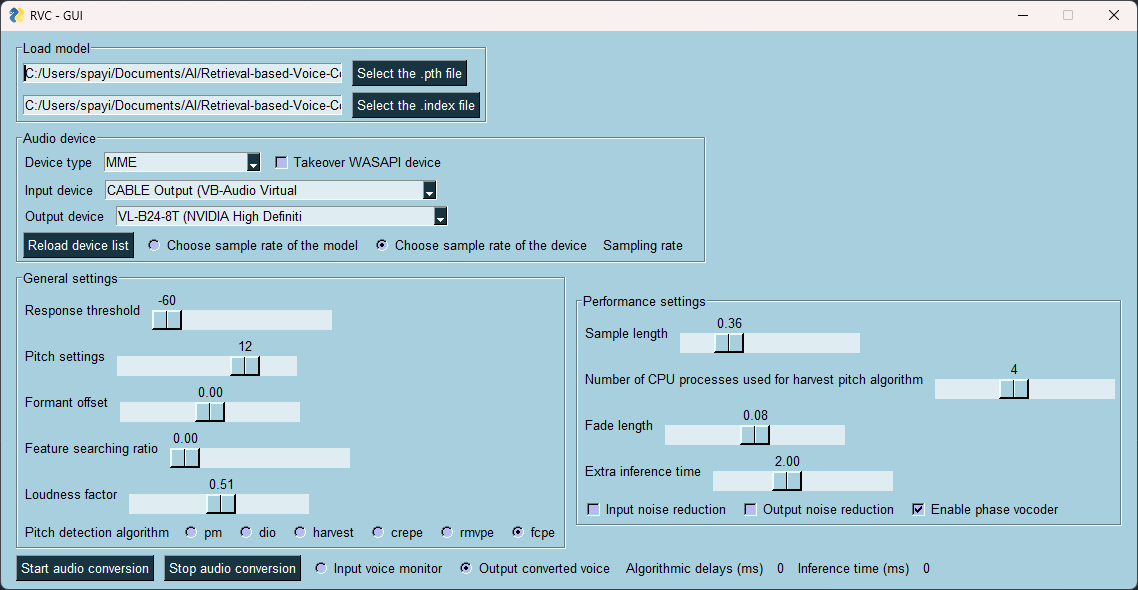

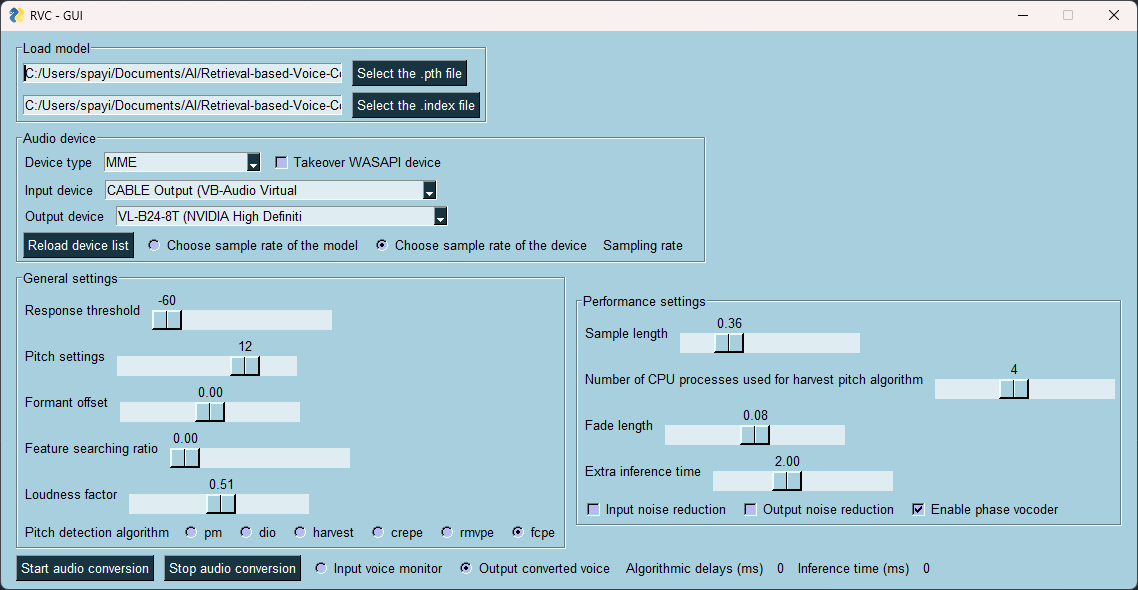

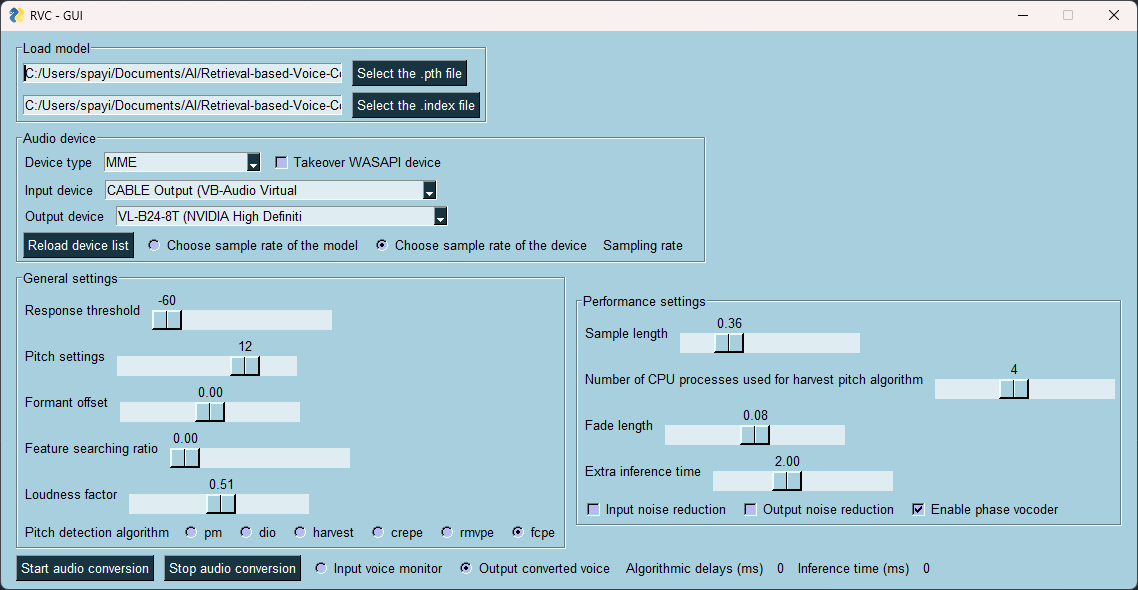

| 实时变声界面 |

|

| 33 |

-

| :---------: |

|

| 34 |

-

|  |

|

| 35 |

-

|

| 36 |

-

## 简介

|

| 37 |

-

本仓库具有以下特点

|

| 38 |

-

+ 使用top1检索替换输入源特征为训练集特征来杜绝音色泄漏

|

| 39 |

-

+ 即便在相对较差的显卡上也能快速训练

|

| 40 |

-

+ 使用少量数据进行训练也能得到较好结果(推荐至少收集10分钟低底噪语音数据)

|

| 41 |

-

+ 可以通过模型融合来改变音色(借助ckpt处理选项卡中的ckpt-merge)

|

| 42 |

-

+ 简单易用的网页界面

|

| 43 |

-

+ 可调用UVR5模型来快速分离人声和伴奏

|

| 44 |

-

+ 使用最先进的[人声音高提取算法InterSpeech2023-RMVPE](#参考项目)根绝哑音问题,效果更好,运行更快,资源占用更少

|

| 45 |

-

+ A卡I卡加速支持

|

| 46 |

-

|

| 47 |

-

点此查看我们的[演示视频](https://www.bilibili.com/video/BV1pm4y1z7Gm/) !

|

| 48 |

-

|

| 49 |

-

## 环境配置

|

| 50 |

-

### Python 版本限制

|

| 51 |

-

> 建议使用 conda 管理 Python 环境

|

| 52 |

-

|

| 53 |

-

> 版本限制原因参见此[bug](https://github.com/facebookresearch/fairseq/issues/5012)

|

| 54 |

-

|

| 55 |

-

```bash

|

| 56 |

-

python --version # 3.8 <= Python < 3.11

|

| 57 |

-

```

|

| 58 |

-

|

| 59 |

-

### Linux/MacOS 一键依赖安装启动脚本

|

| 60 |

-

执行项目根目录下`run.sh`即可一键配置`venv`虚拟环境、自动安装所需依赖并启动主程序。

|

| 61 |

-

```bash

|

| 62 |

-

sh ./run.sh

|

| 63 |

-

```

|

| 64 |

-

|

| 65 |

-

### 手动安装依赖

|

| 66 |

-

1. 安装`pytorch`及其核心依赖,若已安装则跳过。参考自: https://pytorch.org/get-started/locally/

|

| 67 |

-

```bash

|

| 68 |

-

pip install torch torchvision torchaudio

|

| 69 |

-

```

|

| 70 |

-

2. 如果是 win 系统 + Nvidia Ampere 架构(RTX30xx),根据 #21 的经验,需要指定 pytorch 对应的 CUDA 版本

|

| 71 |

-

```bash

|

| 72 |

-

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu117

|

| 73 |

-

```

|

| 74 |

-

3. 根据自己的显卡安装对应依赖

|

| 75 |

-

- N卡

|

| 76 |

-

```bash

|

| 77 |

-

pip install -r requirements/main.txt

|

| 78 |

-

```

|

| 79 |

-

- A卡/I卡

|

| 80 |

-

```bash

|

| 81 |

-

pip install -r requirements/dml.txt

|

| 82 |

-

```

|

| 83 |

-

- A卡ROCM(Linux)

|

| 84 |

-

```bash

|

| 85 |

-

pip install -r requirements/amd.txt

|

| 86 |

-

```

|

| 87 |

-

- I卡IPEX(Linux)

|

| 88 |

-

```bash

|

| 89 |

-

pip install -r requirements/ipex.txt

|

| 90 |

-

```

|

| 91 |

-

|

| 92 |

-

## 其他资源准备

|

| 93 |

-

### 1. assets

|

| 94 |

-

> RVC需要位于`assets`文件夹下的一些模型资源进行推理和训练。

|

| 95 |

-

#### 自动检查/下载资源(默认)

|

| 96 |

-

> 默认情况下,RVC可在主程序启动时自动检查所需资源的完整性。

|

| 97 |

-

|

| 98 |

-

> 即使资源不完整,程序也将继续启动。

|

| 99 |

-

|

| 100 |

-

- 如果您希望下载所有资源,请添加`--update`参数

|

| 101 |

-

- 如果您希望跳���启动时的资源完整性检查,请添加`--nocheck`参数

|

| 102 |

-

|

| 103 |

-

#### 手动下载资源

|

| 104 |

-

> 所有资源文件均位于[Hugging Face space](https://huggingface.co/lj1995/VoiceConversionWebUI/tree/main/)

|

| 105 |

-

|

| 106 |

-

> 你可以在`tools`文件夹找到下载它们的脚本

|

| 107 |

-

|

| 108 |

-

> 你也可以使用模型/整合包/工具的一键下载器:[RVC-Models-Downloader](https://github.com/fumiama/RVC-Models-Downloader)

|

| 109 |

-

|

| 110 |

-

以下是一份清单,包括了所有RVC所需的预模型和其他文件的名称。

|

| 111 |

-

|

| 112 |

-

- ./assets/hubert/hubert_base.pt

|

| 113 |

-

```bash

|

| 114 |

-

rvcmd assets/hubert # RVC-Models-Downloader command

|

| 115 |

-

```

|

| 116 |

-

- ./assets/pretrained

|

| 117 |

-

```bash

|

| 118 |

-

rvcmd assets/v1 # RVC-Models-Downloader command

|

| 119 |

-

```

|

| 120 |

-

- ./assets/uvr5_weights

|

| 121 |

-

```bash

|

| 122 |

-

rvcmd assets/uvr5 # RVC-Models-Downloader command

|

| 123 |

-

```

|

| 124 |

-

想使用v2版本模型的话,需要额外下载

|

| 125 |

-

|

| 126 |

-

- ./assets/pretrained_v2

|

| 127 |

-

```bash

|

| 128 |

-

rvcmd assets/v2 # RVC-Models-Downloader command

|

| 129 |

-

```

|

| 130 |

-

|

| 131 |

-

### 2. 下载 rmvpe 人声音高提取算法所需文件

|

| 132 |

-

|

| 133 |

-

如果你想使用最新的RMVPE人声音高提取算法,则你需要下载音高提取模型参数并放置于`assets/rmvpe`。

|

| 134 |

-

|

| 135 |

-

- 下载[rmvpe.pt](https://huggingface.co/lj1995/VoiceConversionWebUI/blob/main/rmvpe.pt)

|

| 136 |

-

```bash

|

| 137 |

-

rvcmd assets/rmvpe # RVC-Models-Downloader command

|

| 138 |

-

```

|

| 139 |

-

|

| 140 |

-

#### 下载 rmvpe 的 dml 环境(可选, A卡/I卡用户)

|

| 141 |

-

|

| 142 |

-

- 下载[rmvpe.onnx](https://huggingface.co/lj1995/VoiceConversionWebUI/blob/main/rmvpe.onnx)

|

| 143 |

-

```bash

|

| 144 |

-

rvcmd assets/rmvpe # RVC-Models-Downloader command

|

| 145 |

-

```

|

| 146 |

-

|

| 147 |

-

### 3. AMD显卡Rocm(可选, 仅Linux)

|

| 148 |

-

|

| 149 |

-

如果你想基于AMD的Rocm技术在Linux系统上运行RVC,请先在[这里](https://rocm.docs.amd.com/en/latest/deploy/linux/os-native/install.html)安装所需的驱动。

|

| 150 |

-

|

| 151 |

-

若你使用的是Arch Linux,可以使用pacman来安装所需驱动:

|

| 152 |

-

````

|

| 153 |

-

pacman -S rocm-hip-sdk rocm-opencl-sdk

|

| 154 |

-

````

|

| 155 |

-

对于某些型号的显卡,你可能需要额外配置如下的环境变量(如:RX6700XT):

|

| 156 |

-

````

|

| 157 |

-

export ROCM_PATH=/opt/rocm

|

| 158 |

-

export HSA_OVERRIDE_GFX_VERSION=10.3.0

|

| 159 |

-

````

|

| 160 |

-

同时确保你的当前用户处于`render`与`video`用户组内:

|

| 161 |

-

````

|

| 162 |

-

sudo usermod -aG render $USERNAME

|

| 163 |

-

sudo usermod -aG video $USERNAME

|

| 164 |

-

````

|

| 165 |

-

|

| 166 |

-

## 开始使用

|

| 167 |

-

### 直接启动

|

| 168 |

-

使用以下指令来启动 WebUI

|

| 169 |

-

```bash

|

| 170 |

-

python web.py

|

| 171 |

-

```

|

| 172 |

-

### Linux/MacOS 用户

|

| 173 |

-

```bash

|

| 174 |

-

./run.sh

|

| 175 |

-

```

|

| 176 |

-

### 对于需要使用IPEX技术的I卡用户(仅Linux)

|

| 177 |

-

```bash

|

| 178 |

-

source /opt/intel/oneapi/setvars.sh

|

| 179 |

-

./run.sh

|

| 180 |

-

```

|

| 181 |

-

### 使用整合包 (Windows 用户)

|

| 182 |

-

下载并解压`RVC-beta.7z`,解压后双击`go-web.bat`即可一键启动。

|

| 183 |

-

```bash

|

| 184 |

-

rvcmd packs/general/latest # RVC-Models-Downloader command

|

| 185 |

-

```

|

| 186 |

-

|

| 187 |

-

## 参考项目

|

| 188 |

-

+ [ContentVec](https://github.com/auspicious3000/contentvec/)

|

| 189 |

-

+ [VITS](https://github.com/jaywalnut310/vits)

|

| 190 |

-

+ [HIFIGAN](https://github.com/jik876/hifi-gan)

|

| 191 |

-

+ [Gradio](https://github.com/gradio-app/gradio)

|

| 192 |

-

+ [Ultimate Vocal Remover](https://github.com/Anjok07/ultimatevocalremovergui)

|

| 193 |

-

+ [audio-slicer](https://github.com/openvpi/audio-slicer)

|

| 194 |

-

+ [Vocal pitch extraction:RMVPE](https://github.com/Dream-High/RMVPE)

|

| 195 |

-

+ The pretrained model is trained and tested by [yxlllc](https://github.com/yxlllc/RMVPE) and [RVC-Boss](https://github.com/RVC-Boss).

|

| 196 |

-

|

| 197 |

-

## 感谢所有贡献者作出的努力

|

| 198 |

-

[](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/graphs/contributors)

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

docs/cn/faq.md

DELETED

|

@@ -1,150 +0,0 @@

|

|

| 1 |

-

## Q1:一键训练结束没有索引

|

| 2 |

-

|

| 3 |

-

显示"Training is done. The program is closed."则模型训练成功,后续紧邻的报错是假的;

|

| 4 |

-

|

| 5 |

-

|

| 6 |

-

一键训练结束完成没有added开头的索引文件,可能是因为训练集太大卡住了添加索引的步骤;已通过批处理add索引解决内存add索引对内存需求过大的问题。临时可尝试再次点击"训练索引"按钮。

|

| 7 |

-

|

| 8 |

-

|

| 9 |

-

## Q2:训练结束推理没看到训练集的音色

|

| 10 |

-

点刷新音色再看看,如果还没有看看训练有没有报错,控制台和webui的截图,logs/实验名下的log,都可以发给开发者看看。

|

| 11 |

-

|

| 12 |

-

|

| 13 |

-

## Q3:如何分享模型

|

| 14 |

-

rvc_root/logs/实验名 下面存储的pth不是用来分享模型用来推理的,而是为了存储实验状态供复现,以及继续训练用的。用来分享的模型应该是weights文件夹下大小为60+MB的pth文件;

|

| 15 |

-

|

| 16 |

-

后续将把weights/exp_name.pth和logs/exp_name/added_xxx.index合并打包成weights/exp_name.zip省去填写index的步骤,那么zip文件用来分享,不要分享pth文件,除非是想换机器继续训练;

|

| 17 |

-

|

| 18 |

-

如果你把logs文件夹下的几百MB的pth文件复制/分享到weights文件夹下强行用于推理,可能会出现f0,tgt_sr等各种key不存在的报错。你需要用ckpt选项卡最下面,手工或自动(本地logs下如果能找到相关信息则会自动)选择是否携带音高、目标音频采样率的选项后进行ckpt小模型提取(输入路径填G开头的那个),提取完在weights文件夹下会出现60+MB的pth文件,刷新音色后可以选择使用。

|

| 19 |

-

|

| 20 |

-

|

| 21 |

-

## Q4:Connection Error.

|

| 22 |

-

也许你关闭了控制台(黑色窗口)。

|

| 23 |

-

|

| 24 |

-

|

| 25 |

-

## Q5:WebUI弹出Expecting value: line 1 column 1 (char 0).

|

| 26 |

-

请关闭系统局域网代理/全局代理。

|

| 27 |

-

|

| 28 |

-

|

| 29 |

-

这个不仅是客户端的代理,也包括服务端的代理(例如你使用autodl设置了http_proxy和https_proxy学术加速,使用时也需要unset关掉)

|

| 30 |

-

|

| 31 |

-

|

| 32 |

-

## Q6:不用WebUI如何通过命令训练推理

|

| 33 |

-

训练脚本:

|

| 34 |

-

|

| 35 |

-

可先跑通WebUI,消息窗内会显示数据集处理和训练用命令行;

|

| 36 |

-

|

| 37 |

-

|

| 38 |

-

推理脚本:

|

| 39 |

-

|

| 40 |

-

https://huggingface.co/lj1995/VoiceConversionWebUI/blob/main/myinfer.py

|

| 41 |

-

|

| 42 |

-

|

| 43 |

-

例子:

|

| 44 |

-

|

| 45 |

-

|

| 46 |

-

runtime\python.exe myinfer.py 0 "E:\codes\py39\RVC-beta\todo-songs\1111.wav" "E:\codes\py39\logs\mi-test\added_IVF677_Flat_nprobe_7.index" harvest "test.wav" "weights/mi-test.pth" 0.6 cuda:0 True

|

| 47 |

-

|

| 48 |

-

|

| 49 |

-

f0up_key=sys.argv[1]

|

| 50 |

-

|

| 51 |

-

input_path=sys.argv[2]

|

| 52 |

-

|

| 53 |

-

index_path=sys.argv[3]

|

| 54 |

-

|

| 55 |

-

f0method=sys.argv[4]#harvest or pm

|

| 56 |

-

|

| 57 |

-

opt_path=sys.argv[5]

|

| 58 |

-

|

| 59 |

-

model_path=sys.argv[6]

|

| 60 |

-

|

| 61 |

-

index_rate=float(sys.argv[7])

|

| 62 |

-

|

| 63 |

-

device=sys.argv[8]

|

| 64 |

-

|

| 65 |

-

is_half=bool(sys.argv[9])

|

| 66 |

-

|

| 67 |

-

|

| 68 |

-

## Q7:Cuda error/Cuda out of memory.

|

| 69 |

-

小概率是cuda配置问题、设备不支持;大概率是显存不够(out of memory);

|

| 70 |

-

|

| 71 |

-

|

| 72 |

-

训练的话缩小batch size(如果缩小到1还不够只能更换显卡训练),推理的话酌情缩小config.py结尾的x_pad,x_query,x_center,x_max。4G以下显存(例如1060(3G)和各种2G显卡)可以直接放弃,4G显存显卡还有救。

|

| 73 |

-

|

| 74 |

-

|

| 75 |

-

## Q8:total_epoch调多少比较好

|

| 76 |

-

|

| 77 |

-

如果训练集音质差底噪大,20~30足够了,调太高,底模音质无法带高你的低音质训练集

|

| 78 |

-

|

| 79 |

-

如果训练集音质高底噪低时长多,可以调高,200是ok的(训练速度很快,既然你有条件准备高音质训练集,显卡想必条件也不错,肯定不在乎多一些训练时间)

|

| 80 |

-

|

| 81 |

-

|

| 82 |

-

## Q9:需要多少训练集时长

|

| 83 |

-

推荐10min至50min

|

| 84 |

-

|

| 85 |

-

保证音质高底噪低的情况下,如果有个人特色的音色统一,则多多益善

|

| 86 |

-

|

| 87 |

-

高水平的训练集(精简+音色有特色),5min至10min也是ok的,仓库作者本人就经常这么玩

|

| 88 |

-

|

| 89 |

-

也有人拿1min至2min的数据来训练并且训练成功的,但是成功经验是其他人不可复现的,不太具备参考价值。这要求训练集音色特色非常明显(比如说高频气声较明显的萝莉少女音),且音质高;

|

| 90 |

-

|

| 91 |

-

1min以下时长数据目前没见有人尝试(成功)过。不建议进行这种鬼畜行为。

|

| 92 |

-

|

| 93 |

-

|

| 94 |

-

## Q10:index rate干嘛用的,怎么调(科普)

|

| 95 |

-

如果底模和推理源的音质高于训练集的音质,他们可以带高推理结果的音质,但代价可能是音色往底模/推理源的音色靠,这种现象叫做"音色泄露";

|

| 96 |

-

|

| 97 |

-

index rate用来削减/解决音色泄露问题。调到1,则理论上不存在推理源的音色泄露问题,但音质更倾向于训练集。如果训练集音质比推理源低,则index rate调高可能降低音质。调到0,则不具备利用检索混合来保护训练集音色的效果;

|

| 98 |

-

|

| 99 |

-

如果训练集优质时长多,可调高total_epoch,此时模型本身不太会引用推理源和底模的音色,很少存在"音色泄露"问题,此时index_rate不重要,你甚至可以不建立/分享index索引文件。

|

| 100 |

-

|

| 101 |

-

|

| 102 |

-

## Q11:推理怎么选gpu

|

| 103 |

-

config.py文件里device cuda:后面选择卡号;

|

| 104 |

-

|

| 105 |

-

卡号和显卡的映射关系,在��练选项卡的显卡信息栏里能看到。

|

| 106 |

-

|

| 107 |

-

|

| 108 |

-

## Q12:如何推理训练中间保存的pth

|

| 109 |

-

通过ckpt选项卡最下面提取小模型。

|

| 110 |

-

|

| 111 |

-

|

| 112 |

-

|

| 113 |

-

## Q13:如何中断和继续训练

|

| 114 |

-

现阶段只能关闭WebUI控制台双击go-web.bat重启程序。网页参数也要刷新重新填写;

|

| 115 |

-

|

| 116 |

-

继续训练:相同网页参数点训练模型,就会接着上次的checkpoint继续训练。

|

| 117 |

-

|

| 118 |

-

|

| 119 |

-

## Q14:训练时出现文件页面/内存error

|

| 120 |

-

进程开太多了,内存炸了。你可能可以通过如下方式解决

|

| 121 |

-

|

| 122 |

-

1、"提取音高和处理数据使用的CPU进程数" 酌情拉低;

|

| 123 |

-

|

| 124 |

-

2、训练集音频手工切一下,不要太长。

|

| 125 |

-

|

| 126 |

-

|

| 127 |

-

|

| 128 |

-

## Q15:如何中途加数据训练

|

| 129 |

-

1、所有数据新建一个实验名;

|

| 130 |

-

|

| 131 |

-

2、拷贝上一次的最新的那个G和D文件(或者你想基于哪个中间ckpt训练,也可以拷贝中间的)到新实验名;下

|

| 132 |

-

|

| 133 |

-

3、一键训练新实验名,他会继续上一次的最新进度训练。

|

| 134 |

-

|

| 135 |

-

|

| 136 |

-

## Q16: error about llvmlite.dll

|

| 137 |

-

|

| 138 |

-

OSError: Could not load shared object file: llvmlite.dll

|

| 139 |

-

|

| 140 |

-

FileNotFoundError: Could not find module lib\site-packages\llvmlite\binding\llvmlite.dll (or one of its dependencies). Try using the full path with constructor syntax.

|

| 141 |

-

|

| 142 |

-

win平台会报这个错,装上https://aka.ms/vs/17/release/vc_redist.x64.exe这个再重启WebUI就好了。

|

| 143 |

-

|

| 144 |

-

## Q17: RuntimeError: The expanded size of the tensor (17280) must match the existing size (0) at non-singleton dimension 1. Target sizes: [1, 17280]. Tensor sizes: [0]

|

| 145 |

-

|

| 146 |

-

wavs16k文件夹下,找到文件大小显著比其他都小的一些音频文件,删掉,点击训练模型,就不会报错了,不过由于一键流程中断了你训练完模型还要点训练索引。

|

| 147 |

-

|

| 148 |

-

## Q18: RuntimeError: The size of tensor a (24) must match the size of tensor b (16) at non-singleton dimension 2

|

| 149 |

-

|

| 150 |

-

不要中途变更采样率继续训练。如果一定要变更,应更换实验名从头训练。当然你也可以把上次提取的音高和特征(0/1/2/2b folders)拷贝过去加速训练流程。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

docs/en/faiss_tips_en.md

DELETED

|

@@ -1,102 +0,0 @@

|

|

| 1 |

-

faiss tuning TIPS

|

| 2 |

-

==================

|

| 3 |

-

# about faiss

|

| 4 |

-

faiss is a library of neighborhood searches for dense vectors, developed by facebook research, which efficiently implements many approximate neighborhood search methods.

|

| 5 |

-

Approximate Neighbor Search finds similar vectors quickly while sacrificing some accuracy.

|

| 6 |

-

|

| 7 |

-

## faiss in RVC

|

| 8 |

-

In RVC, for the embedding of features converted by HuBERT, we search for embeddings similar to the embedding generated from the training data and mix them to achieve a conversion that is closer to the original speech. However, since this search takes time if performed naively, high-speed conversion is realized by using approximate neighborhood search.

|

| 9 |

-

|

| 10 |

-

# implementation overview

|

| 11 |

-

In '/logs/your-experiment/3_feature256' where the model is located, features extracted by HuBERT from each voice data are located.

|

| 12 |

-

From here we read the npy files in order sorted by filename and concatenate the vectors to create big_npy. (This vector has shape [N, 256].)

|

| 13 |

-

After saving big_npy as /logs/your-experiment/total_fea.npy, train it with faiss.

|

| 14 |

-

|

| 15 |

-

In this article, I will explain the meaning of these parameters.

|

| 16 |

-

|

| 17 |

-

# Explanation of the method

|

| 18 |

-

## index factory

|

| 19 |

-

An index factory is a unique faiss notation that expresses a pipeline that connects multiple approximate neighborhood search methods as a string.

|

| 20 |

-

This allows you to try various approximate neighborhood search methods simply by changing the index factory string.

|

| 21 |

-

In RVC it is used like this:

|

| 22 |

-

|

| 23 |

-

```python

|

| 24 |

-

index = faiss.index_factory(256, "IVF%s,Flat" % n_ivf)

|

| 25 |

-

```

|

| 26 |

-

Among the arguments of index_factory, the first is the number of dimensions of the vector, the second is the index factory string, and the third is the distance to use.

|

| 27 |

-

|

| 28 |

-

For more detailed notation

|

| 29 |

-

https://github.com/facebookresearch/faiss/wiki/The-index-factory

|

| 30 |

-

|

| 31 |

-

## index for distance

|

| 32 |

-

There are two typical indexes used as similarity of embedding as follows.

|

| 33 |

-

|

| 34 |

-

- Euclidean distance (METRIC_L2)

|

| 35 |

-

- inner product (METRIC_INNER_PRODUCT)

|

| 36 |

-

|

| 37 |

-

Euclidean distance takes the squared difference in each dimension, sums the differences in all dimensions, and then takes the square root. This is the same as the distance in 2D and 3D that we use on a daily basis.

|

| 38 |

-

The inner product is not used as an index of similarity as it is, and the cosine similarity that takes the inner product after being normalized by the L2 norm is generally used.

|

| 39 |

-

|

| 40 |

-

Which is better depends on the case, but cosine similarity is often used in embedding obtained by word2vec and similar image retrieval models learned by ArcFace. If you want to do l2 normalization on vector X with numpy, you can do it with the following code with eps small enough to avoid 0 division.

|

| 41 |

-

|

| 42 |

-

```python

|

| 43 |

-

X_normed = X / np.maximum(eps, np.linalg.norm(X, ord=2, axis=-1, keepdims=True))

|

| 44 |

-

```

|

| 45 |

-

|

| 46 |

-

Also, for the index factory, you can change the distance index used for calculation by choosing the value to pass as the third argument.

|

| 47 |

-

|

| 48 |

-

```python

|

| 49 |

-

index = faiss.index_factory(dimention, text, faiss.METRIC_INNER_PRODUCT)

|

| 50 |

-

```

|

| 51 |

-

|

| 52 |

-

## IVF

|

| 53 |

-

IVF (Inverted file indexes) is an algorithm similar to the inverted index in full-text search.

|

| 54 |

-

During learning, the search target is clustered with kmeans, and Voronoi partitioning is performed using the cluster center. Each data point is assigned a cluster, so we create a dictionary that looks up the data points from the clusters.

|

| 55 |

-

|

| 56 |

-

For example, if clusters are assigned as follows

|

| 57 |

-

|index|Cluster|

|

| 58 |

-

|-----|-------|

|

| 59 |

-

|1|A|

|

| 60 |

-

|2|B|

|

| 61 |

-

|3|A|

|

| 62 |

-

|4|C|

|

| 63 |

-

|5|B|

|

| 64 |

-

|

| 65 |

-

The resulting inverted index looks like this:

|

| 66 |

-

|

| 67 |

-

|cluster|index|

|

| 68 |

-

|-------|-----|

|

| 69 |

-

|A|1, 3|

|

| 70 |

-

|B|2, 5|

|

| 71 |

-

|C|4|

|

| 72 |

-

|

| 73 |

-

When searching, we first search n_probe clusters from the clusters, and then calculate the distances for the data points belonging to each cluster.

|

| 74 |

-

|

| 75 |

-

# recommend parameter

|

| 76 |

-

There are official guidelines on how to choose an index, so I will explain accordingly.

|

| 77 |

-

https://github.com/facebookresearch/faiss/wiki/Guidelines-to-choose-an-index

|

| 78 |

-

|

| 79 |

-

For datasets below 1M, 4bit-PQ is the most efficient method available in faiss as of April 2023.

|

| 80 |

-

Combining this with IVF, narrowing down the candidates with 4bit-PQ, and finally recalculating the distance with an accurate index can be described by using the following index factory.

|

| 81 |

-

|

| 82 |

-

```python

|

| 83 |

-

index = faiss.index_factory(256, "IVF1024,PQ128x4fs,RFlat")

|

| 84 |

-

```

|

| 85 |

-

|

| 86 |

-

## Recommended parameters for IVF

|

| 87 |

-

Consider the case of too many IVFs. For example, if coarse quantization by IVF is performed for the number of data, this is the same as a naive exhaustive search and is inefficient.

|

| 88 |

-

For 1M or less, IVF values are recommended between 4*sqrt(N) ~ 16*sqrt(N) for N number of data points.

|

| 89 |

-

|

| 90 |

-

Since the calculation time increases in proportion to the number of n_probes, please consult with the accuracy and choose appropriately. Personally, I don't think RVC needs that much accuracy, so n_probe = 1 is fine.

|

| 91 |

-

|

| 92 |

-

## FastScan

|

| 93 |

-

FastScan is a method that enables high-speed approximation of distances by Cartesian product quantization by performing them in registers.

|

| 94 |

-

Cartesian product quantization performs clustering independently for each d dimension (usually d = 2) during learning, calculates the distance between clusters in advance, and creates a lookup table. At the time of prediction, the distance of each dimension can be calculated in O(1) by looking at the lookup table.

|

| 95 |

-

So the number you specify after PQ usually specifies half the dimension of the vector.

|

| 96 |

-

|

| 97 |

-

For a more detailed description of FastScan, please refer to the official documentation.

|

| 98 |

-

https://github.com/facebookresearch/faiss/wiki/Fast-accumulation-of-PQ-and-AQ-codes-(FastScan)

|

| 99 |

-

|

| 100 |

-

## RFlat

|

| 101 |

-

RFlat is an instruction to recalculate the rough distance calculated by FastScan with the exact distance specified by the third argument of index factory.

|

| 102 |

-

When getting k neighbors, k*k_factor points are recalculated.

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

docs/en/faq_en.md

DELETED

|

@@ -1,114 +0,0 @@

|

|

| 1 |

-

## Q1:Cannot find index file after "One-click Training".

|

| 2 |

-

If it displays "Training is done. The program is closed," then the model has been trained successfully, and the subsequent errors are fake;

|

| 3 |

-

|

| 4 |

-

The lack of an 'added' index file after One-click training may be due to the training set being too large, causing the addition of the index to get stuck; this has been resolved by using batch processing to add the index, which solves the problem of memory overload when adding the index. As a temporary solution, try clicking the "Train Index" button again.<br>

|

| 5 |

-

|

| 6 |

-

## Q2:Cannot find the model in “Inferencing timbre” after training

|

| 7 |

-

Click “Refresh timbre list” and check again; if still not visible, check if there are any errors during training and send screenshots of the console, web UI, and logs/experiment_name/*.log to the developers for further analysis.<br>

|

| 8 |

-

|

| 9 |

-

## Q3:How to share a model/How to use others' models?

|

| 10 |

-

The pth files stored in rvc_root/logs/experiment_name are not meant for sharing or inference, but for storing the experiment checkpoits for reproducibility and further training. The model to be shared should be the 60+MB pth file in the weights folder;

|

| 11 |

-

|

| 12 |

-

In the future, weights/exp_name.pth and logs/exp_name/added_xxx.index will be merged into a single weights/exp_name.zip file to eliminate the need for manual index input; so share the zip file, not the pth file, unless you want to continue training on a different machine;

|

| 13 |

-

|

| 14 |

-

Copying/sharing the several hundred MB pth files from the logs folder to the weights folder for forced inference may result in errors such as missing f0, tgt_sr, or other keys. You need to use the ckpt tab at the bottom to manually or automatically (if the information is found in the logs/exp_name), select whether to include pitch infomation and target audio sampling rate options and then extract the smaller model. After extraction, there will be a 60+ MB pth file in the weights folder, and you can refresh the voices to use it.<br>

|

| 15 |

-

|

| 16 |

-

## Q4:Connection Error.

|

| 17 |

-

You may have closed the console (black command line window).<br>

|

| 18 |

-

|

| 19 |

-

## Q5:WebUI popup 'Expecting value: line 1 column 1 (char 0)'.

|

| 20 |

-

Please disable system LAN proxy/global proxy and then refresh.<br>

|

| 21 |

-

|

| 22 |

-

## Q6:How to train and infer without the WebUI?

|

| 23 |

-

Training script:<br>

|

| 24 |

-

You can run training in WebUI first, and the command-line versions of dataset preprocessing and training will be displayed in the message window.<br>

|

| 25 |

-

|

| 26 |

-

Inference script:<br>

|

| 27 |

-

https://huggingface.co/lj1995/VoiceConversionWebUI/blob/main/myinfer.py<br>

|

| 28 |

-

|

| 29 |

-

|

| 30 |

-

e.g.<br>

|

| 31 |

-

|

| 32 |

-

runtime\python.exe myinfer.py 0 "E:\codes\py39\RVC-beta\todo-songs\1111.wav" "E:\codes\py39\logs\mi-test\added_IVF677_Flat_nprobe_7.index" harvest "test.wav" "weights/mi-test.pth" 0.6 cuda:0 True<br>

|

| 33 |

-

|

| 34 |

-

|

| 35 |

-

f0up_key=sys.argv[1]<br>

|

| 36 |

-

input_path=sys.argv[2]<br>

|

| 37 |

-

index_path=sys.argv[3]<br>

|

| 38 |

-

f0method=sys.argv[4]#harvest or pm<br>

|

| 39 |

-

opt_path=sys.argv[5]<br>

|

| 40 |

-

model_path=sys.argv[6]<br>

|

| 41 |

-

index_rate=float(sys.argv[7])<br>

|

| 42 |

-

device=sys.argv[8]<br>

|

| 43 |

-

is_half=bool(sys.argv[9])<br>

|

| 44 |

-

|

| 45 |

-

## Q7:Cuda error/Cuda out of memory.

|

| 46 |

-

There is a small chance that there is a problem with the CUDA configuration or the device is not supported; more likely, there is not enough memory (out of memory).<br>

|

| 47 |

-

|

| 48 |

-

For training, reduce the batch size (if reducing to 1 is still not enough, you may need to change the graphics card); for inference, adjust the x_pad, x_query, x_center, and x_max settings in the config.py file as needed. 4G or lower memory cards (e.g. 1060(3G) and various 2G cards) can be abandoned, while 4G memory cards still have a chance.<br>

|

| 49 |

-

|

| 50 |

-

## Q8:How many total_epoch are optimal?

|

| 51 |

-

If the training dataset's audio quality is poor and the noise floor is high, 20-30 epochs are sufficient. Setting it too high won't improve the audio quality of your low-quality training set.<br>

|

| 52 |

-

|

| 53 |

-

If the training set audio quality is high, the noise floor is low, and there is sufficient duration, you can increase it. 200 is acceptable (since training is fast, and if you're able to prepare a high-quality training set, your GPU likely can handle a longer training duration without issue).<br>

|

| 54 |

-

|

| 55 |

-

## Q9:How much training set duration is needed?

|

| 56 |

-

|

| 57 |

-

A dataset of around 10min to 50min is recommended.<br>

|

| 58 |

-

|

| 59 |

-

With guaranteed high sound quality and low bottom noise, more can be added if the dataset's timbre is uniform.<br>

|

| 60 |

-

|

| 61 |

-

For a high-level training set (lean + distinctive tone), 5min to 10min is fine.<br>

|

| 62 |

-

|

| 63 |

-

There are some people who have trained successfully with 1min to 2min data, but the success is not reproducible by others and is not very informative. <br>This requires that the training set has a very distinctive timbre (e.g. a high-frequency airy anime girl sound) and the quality of the audio is high;

|

| 64 |

-

Data of less than 1min duration has not been successfully attempted so far. This is not recommended.<br>

|

| 65 |

-

|

| 66 |

-

|

| 67 |

-

## Q10:What is the index rate for and how to adjust it?

|

| 68 |

-

If the tone quality of the pre-trained model and inference source is higher than that of the training set, they can bring up the tone quality of the inference result, but at the cost of a possible tone bias towards the tone of the underlying model/inference source rather than the tone of the training set, which is generally referred to as "tone leakage".<br>

|

| 69 |

-

|

| 70 |

-

The index rate is used to reduce/resolve the timbre leakage problem. If the index rate is set to 1, theoretically there is no timbre leakage from the inference source and the timbre quality is more biased towards the training set. If the training set has a lower sound quality than the inference source, then a higher index rate may reduce the sound quality. Turning it down to 0 does not have the effect of using retrieval blending to protect the training set tones.<br>

|

| 71 |

-

|

| 72 |

-

If the training set has good audio quality and long duration, turn up the total_epoch, when the model itself is less likely to refer to the inferred source and the pretrained underlying model, and there is little "tone leakage", the index_rate is not important and you can even not create/share the index file.<br>

|

| 73 |

-

|

| 74 |

-

## Q11:How to choose the gpu when inferring?

|

| 75 |

-

In the config.py file, select the card number after "device cuda:".<br>

|

| 76 |

-

|

| 77 |

-

The mapping between card number and graphics card can be seen in the graphics card information section of the training tab.<br>

|

| 78 |

-

|

| 79 |

-

## Q12:How to use the model saved in the middle of training?

|

| 80 |

-

Save via model extraction at the bottom of the ckpt processing tab.

|

| 81 |

-

|

| 82 |

-

## Q13:File/memory error(when training)?

|

| 83 |

-

Too many processes and your memory is not enough. You may fix it by:

|

| 84 |

-

|

| 85 |

-

1、decrease the input in field "Threads of CPU".

|

| 86 |

-

|

| 87 |

-

2、pre-cut trainset to shorter audio files.

|

| 88 |

-

|

| 89 |

-

## Q14: How to continue training using more data

|

| 90 |

-

|

| 91 |

-

step1: put all wav data to path2.

|

| 92 |

-

|

| 93 |

-

step2: exp_name2+path2 -> process dataset and extract feature.

|

| 94 |

-

|

| 95 |

-

step3: copy the latest G and D file of exp_name1 (your previous experiment) into exp_name2 folder.

|

| 96 |

-

|

| 97 |

-

step4: click "train the model", and it will continue training from the beginning of your previous exp model epoch.

|

| 98 |

-

|

| 99 |

-

## Q15: error about llvmlite.dll

|

| 100 |

-

|

| 101 |

-

OSError: Could not load shared object file: llvmlite.dll

|

| 102 |

-

|

| 103 |

-

FileNotFoundError: Could not find module lib\site-packages\llvmlite\binding\llvmlite.dll (or one of its dependencies). Try using the full path with constructor syntax.

|

| 104 |

-

|

| 105 |

-

The issue will happen in windows, install https://aka.ms/vs/17/release/vc_redist.x64.exe and it will be fixed.

|

| 106 |

-

|

| 107 |

-

## Q16: RuntimeError: The expanded size of the tensor (17280) must match the existing size (0) at non-singleton dimension 1. Target sizes: [1, 17280]. Tensor sizes: [0]

|

| 108 |

-

|

| 109 |

-

Delete the wav files whose size is significantly smaller than others, and that won't happen again. Than click "train the model"and "train the index".

|

| 110 |

-

|

| 111 |

-

## Q17: RuntimeError: The size of tensor a (24) must match the size of tensor b (16) at non-singleton dimension 2

|

| 112 |

-

|

| 113 |

-

Do not change the sampling rate and then continue training. If it is necessary to change, the exp name should be changed and the model will be trained from scratch. You can also copy the pitch and features (0/1/2/2b folders) extracted last time to accelerate the training process.

|

| 114 |

-

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

docs/en/training_tips_en.md

DELETED

|

@@ -1,65 +0,0 @@

|

|

| 1 |

-

Instructions and tips for RVC training

|

| 2 |

-

======================================

|

| 3 |

-

This TIPS explains how data training is done.

|

| 4 |

-

|

| 5 |

-

# Training flow

|

| 6 |

-

I will explain along the steps in the training tab of the GUI.

|

| 7 |

-

|

| 8 |

-

## step1

|

| 9 |

-

Set the experiment name here.

|

| 10 |

-

|

| 11 |

-

You can also set here whether the model should take pitch into account.

|

| 12 |

-

If the model doesn't consider pitch, the model will be lighter, but not suitable for singing.

|

| 13 |

-

|

| 14 |

-

Data for each experiment is placed in `/logs/your-experiment-name/`.

|

| 15 |

-

|

| 16 |

-

## step2a

|

| 17 |

-

Loads and preprocesses audio.

|

| 18 |

-

|

| 19 |

-

### load audio

|

| 20 |

-

If you specify a folder with audio, the audio files in that folder will be read automatically.

|

| 21 |

-

For example, if you specify `C:Users\hoge\voices`, `C:Users\hoge\voices\voice.mp3` will be loaded, but `C:Users\hoge\voices\dir\voice.mp3` will Not loaded.

|

| 22 |

-

|

| 23 |

-

Since ffmpeg is used internally for reading audio, if the extension is supported by ffmpeg, it will be read automatically.

|

| 24 |

-

After converting to int16 with ffmpeg, convert to float32 and normalize between -1 to 1.

|

| 25 |

-

|

| 26 |

-

### denoising

|

| 27 |

-

The audio is smoothed by scipy's filtfilt.

|

| 28 |

-

|

| 29 |

-

### Audio Split

|

| 30 |

-

First, the input audio is divided by detecting parts of silence that last longer than a certain period (max_sil_kept=5 seconds?). After splitting the audio on silence, split the audio every 4 seconds with an overlap of 0.3 seconds. For audio separated within 4 seconds, after normalizing the volume, convert the wav file to `/logs/your-experiment-name/0_gt_wavs` and then convert it to 16k sampling rate to `/logs/your-experiment-name/1_16k_wavs ` as a wav file.

|

| 31 |

-

|

| 32 |

-

## step2b

|

| 33 |

-

### Extract pitch

|

| 34 |

-

Extract pitch information from wav files. Extract the pitch information (=f0) using the method built into parselmouth or pyworld and save it in `/logs/your-experiment-name/2a_f0`. Then logarithmically convert the pitch information to an integer between 1 and 255 and save it in `/logs/your-experiment-name/2b-f0nsf`.

|

| 35 |

-

|

| 36 |

-

### Extract feature_print

|

| 37 |

-

Convert the wav file to embedding in advance using HuBERT. Read the wav file saved in `/logs/your-experiment-name/1_16k_wavs`, convert the wav file to 256-dimensional features with HuBERT, and save in npy format in `/logs/your-experiment-name/3_feature256`.

|

| 38 |

-

|

| 39 |

-

## step3

|

| 40 |

-

train the model.

|

| 41 |

-

### Glossary for Beginners

|

| 42 |

-

In deep learning, the data set is divided and the learning proceeds little by little. In one model update (step), batch_size data are retrieved and predictions and error corrections are performed. Doing this once for a dataset counts as one epoch.

|

| 43 |

-

|

| 44 |

-

Therefore, the learning time is the learning time per step x (the number of data in the dataset / batch size) x the number of epochs. In general, the larger the batch size, the more stable the learning becomes (learning time per step ÷ batch size) becomes smaller, but it uses more GPU memory. GPU RAM can be checked with the nvidia-smi command. Learning can be done in a short time by increasing the batch size as much as possible according to the machine of the execution environment.

|

| 45 |

-

|

| 46 |

-

### Specify pretrained model

|

| 47 |

-

RVC starts training the model from pretrained weights instead of from 0, so it can be trained with a small dataset.

|

| 48 |

-

|

| 49 |

-

By default

|

| 50 |

-

|

| 51 |

-

- If you consider pitch, it loads `rvc-location/pretrained/f0G40k.pth` and `rvc-location/pretrained/f0D40k.pth`.

|

| 52 |

-

- If you don't consider pitch, it loads `rvc-location/pretrained/G40k.pth` and `rvc-location/pretrained/D40k.pth`.

|

| 53 |

-

|

| 54 |

-

When learning, model parameters are saved in `logs/your-experiment-name/G_{}.pth` and `logs/your-experiment-name/D_{}.pth` for each save_every_epoch, but by specifying this path, you can start learning. You can restart or start training from model weights learned in a different experiment.

|

| 55 |

-

|

| 56 |

-

### learning index

|

| 57 |

-

RVC saves the HuBERT feature values used during training, and during inference, searches for feature values that are similar to the feature values used during learning to perform inference. In order to perform this search at high speed, the index is learned in advance.

|

| 58 |

-

For index learning, we use the approximate neighborhood search library faiss. Read the feature value of `logs/your-experiment-name/3_feature256` and use it to learn the index, and save it as `logs/your-experiment-name/add_XXX.index`.

|

| 59 |

-

|

| 60 |

-

(From the 20230428update version, it is read from the index, and saving / specifying is no longer necessary.)

|

| 61 |

-

|

| 62 |

-

### Button description

|

| 63 |

-

- Train model: After executing step2b, press this button to train the model.

|

| 64 |

-

- Train feature index: After training the model, perform index learning.

|

| 65 |

-

- One-click training: step2b, model training and feature index training all at once.

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

docs/fr/README.fr.md

DELETED

|

@@ -1,166 +0,0 @@

|

|

| 1 |

-

<div align="center">

|

| 2 |

-

|

| 3 |

-

# Retrieval-based-Voice-Conversion-WebUI

|

| 4 |

-

Un framework simple et facile à utiliser pour la conversion vocale (modificateur de voix) basé sur VITS

|

| 5 |

-

|

| 6 |

-

|

| 7 |

-

|

| 8 |

-

[](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI)

|

| 10 |

-

|

| 11 |

-

|

| 12 |

-

|

| 13 |

-

[](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/blob/main/LICENSE)

|

| 14 |

-

[](https://huggingface.co/lj1995/VoiceConversionWebUI/tree/main/)

|

| 15 |

-

|

| 16 |

-

[](https://discord.gg/HcsmBBGyVk)

|

| 17 |

-

|

| 18 |

-

[**FAQ**](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/wiki/%E5%B8%B8%E8%A7%81%E9%97%AE%E9%A2%98%E8%A7%A3%E7%AD%94) | [**AutoDL·Formation d'un chanteur AI pour 5 centimes**](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/wiki/Autodl%E8%AE%AD%E7%BB%83RVC%C2%B7AI%E6%AD%8C%E6%89%8B%E6%95%99%E7%A8%8B) | [**Enregistrement des expériences comparatives**](https://github.com/fumiama/Retrieval-based-Voice-Conversion-WebUI/wiki/%E5%AF%B9%E7%85%A7%E5%AE%9E%E9%AA%8C%C2%B7%E5%AE%9E%E9%AA%8C%E8%AE%B0%E5%BD%95) | [**Démonstration en ligne**](https://huggingface.co/spaces/Ricecake123/RVC-demo)

|

| 19 |

-

|

| 20 |

-

</div>

|

| 21 |

-

|

| 22 |

-

------

|

| 23 |

-

|

| 24 |

-

[**English**](../en/README.en.md) | [ **中文简体**](../../README.md) | [**日本語**](../jp/README.ja.md) | [**한국어**](../kr/README.ko.md) ([**韓國語**](../kr/README.ko.han.md)) | [**Français**](../fr/README.fr.md) | [**Turc**](../tr/README.tr.md) | [**Português**](../pt/README.pt.md)

|

| 25 |

-

|

| 26 |

-

Cliquez ici pour voir notre [vidéo de démonstration](https://www.bilibili.com/video/BV1pm4y1z7Gm/) !

|

| 27 |

-

|

| 28 |

-

> Conversion vocale en temps réel avec RVC : [w-okada/voice-changer](https://github.com/w-okada/voice-changer)

|

| 29 |

-

|

| 30 |

-

> Le modèle de base est formé avec près de 50 heures de données VCTK de haute qualité et open source. Aucun souci concernant les droits d'auteur, n'hésitez pas à l'utiliser.

|

| 31 |

-

|

| 32 |

-

> Attendez-vous au modèle de base RVCv3 : plus de paramètres, plus de données, de meilleurs résultats, une vitesse d'inférence presque identique, et nécessite moins de données pour la formation.

|

| 33 |

-

|

| 34 |

-

## Introduction

|

| 35 |

-

Ce dépôt a les caractéristiques suivantes :

|

| 36 |

-

+ Utilise le top1 pour remplacer les caractéristiques de la source d'entrée par les caractéristiques de l'ensemble d'entraînement pour éliminer les fuites de timbre vocal.

|

| 37 |

-

+ Peut être formé rapidement même sur une carte graphique relativement moins performante.

|

| 38 |

-

+ Obtient de bons résultats même avec peu de données pour la formation (il est recommandé de collecter au moins 10 minutes de données vocales avec un faible bruit de fond).

|

| 39 |

-

+ Peut changer le timbre vocal en fusionnant des modèles (avec l'aide de l'onglet ckpt-merge).

|

| 40 |

-

+ Interface web simple et facile à utiliser.

|

| 41 |

-

+ Peut appeler le modèle UVR5 pour séparer rapidement la voix et l'accompagnement.

|

| 42 |

-

+ Utilise l'algorithme de pitch vocal le plus avancé [InterSpeech2023-RMVPE](#projets-référencés) pour éliminer les problèmes de voix muette. Meilleurs résultats, plus rapide que crepe_full, et moins gourmand en ressources.

|

| 43 |

-

+ Support d'accélération pour les cartes AMD et Intel.

|

| 44 |

-

|

| 45 |

-

## Configuration de l'environnement

|

| 46 |

-

Exécutez les commandes suivantes dans un environnement Python de version 3.8 ou supérieure.

|

| 47 |

-

|

| 48 |

-

(Windows/Linux)

|

| 49 |

-

Installez d'abord les dépendances principales via pip :

|

| 50 |

-

```bash

|

| 51 |

-

# Installez Pytorch et ses dépendances essentielles, sautez si déjà installé.

|

| 52 |

-

# Voir : https://pytorch.org/get-started/locally/

|

| 53 |

-

pip install torch torchvision torchaudio

|

| 54 |

-

|

| 55 |

-

# Pour les utilisateurs de Windows avec une architecture Nvidia Ampere (RTX30xx), en se basant sur l'expérience #21, spécifiez la version CUDA correspondante pour Pytorch.

|

| 56 |

-

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu117

|

| 57 |

-

|

| 58 |

-

# Pour Linux + carte AMD, utilisez cette version de Pytorch:

|

| 59 |

-

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/rocm5.4.2

|

| 60 |

-

```

|

| 61 |

-

|

| 62 |

-

Vous pouvez utiliser poetry pour installer les dépendances :

|

| 63 |

-

```bash

|

| 64 |

-

# Installez l'outil de gestion des dépendances Poetry, sautez si déjà installé.

|

| 65 |

-

# Voir : https://python-poetry.org/docs/#installation

|

| 66 |

-

curl -sSL https://install.python-poetry.org | python3 -

|

| 67 |

-

|

| 68 |

-

# Installez les dépendances avec poetry.

|

| 69 |

-

poetry install

|

| 70 |

-

```

|

| 71 |

-

|

| 72 |

-

Ou vous pouvez utiliser pip pour installer les dépendances :

|

| 73 |

-

```bash

|

| 74 |

-

# Cartes Nvidia :

|

| 75 |

-

pip install -r requirements/main.txt

|

| 76 |

-

|

| 77 |

-

# Cartes AMD/Intel :

|

| 78 |

-

pip install -r requirements/dml.txt

|

| 79 |

-

|

| 80 |

-

# Cartes Intel avec IPEX

|

| 81 |

-

pip install -r requirements/ipex.txt

|

| 82 |

-

|

| 83 |

-

# Cartes AMD sur Linux (ROCm)

|

| 84 |

-

pip install -r requirements/amd.txt

|

| 85 |

-

```

|

| 86 |

-

|

| 87 |

-

------

|

| 88 |

-

Les utilisateurs de Mac peuvent exécuter `run.sh` pour installer les dépendances :

|

| 89 |

-

```bash

|

| 90 |

-

sh ./run.sh

|

| 91 |

-

```

|

| 92 |

-

|

| 93 |

-

## Préparation d'autres modèles pré-entraînés

|

| 94 |

-

RVC nécessite d'autres modèles pré-entraînés pour l'inférence et la formation.

|

| 95 |

-

|

| 96 |

-

```bash

|

| 97 |

-

#Télécharger tous les modèles depuis https://huggingface.co/lj1995/VoiceConversionWebUI/tree/main/

|

| 98 |

-

python tools/download_models.py

|

| 99 |

-

```

|

| 100 |

-

|

| 101 |

-

Ou vous pouvez télécharger ces modèles depuis notre [espace Hugging Face](https://huggingface.co/lj1995/VoiceConversionWebUI/tree/main/).

|

| 102 |

-

|

| 103 |

-

Voici une liste des modèles et autres fichiers requis par RVC :

|

| 104 |

-

```bash

|

| 105 |

-

./assets/hubert/hubert_base.pt

|

| 106 |

-

|

| 107 |

-

./assets/pretrained

|

| 108 |

-

|

| 109 |

-

./assets/uvr5_weights

|

| 110 |

-

|

| 111 |

-

# Pour tester la version v2 du modèle, téléchargez également :

|

| 112 |

-

|

| 113 |

-

./assets/pretrained_v2

|

| 114 |

-

|

| 115 |

-

# Si vous souhaitez utiliser le dernier algorithme RMVPE de pitch vocal, téléchargez les paramètres du modèle de pitch et placez-les dans le répertoire racine de RVC.

|

| 116 |

-

|

| 117 |

-

https://huggingface.co/lj1995/VoiceConversionWebUI/blob/main/rmvpe.pt

|

| 118 |

-

|

| 119 |

-

# Les utilisateurs de cartes AMD/Intel nécessitant l'environnement DML doivent télécharger :

|

| 120 |

-

|

| 121 |

-

https://huggingface.co/lj1995/VoiceConversionWebUI/blob/main/rmvpe.onnx

|

| 122 |

-

|

| 123 |

-

```

|

| 124 |

-

Pour les utilisateurs d'Intel ARC avec IPEX, exécutez d'abord `source /opt/intel/oneapi/setvars.sh`.

|

| 125 |

-

Ensuite, exécutez la commande suivante pour démarrer WebUI :

|

| 126 |

-

```bash

|

| 127 |

-

python web.py

|

| 128 |

-

```

|

| 129 |

-

|

| 130 |

-

Si vous utilisez Windows ou macOS, vous pouvez télécharger et extraire `RVC-beta.7z`. Les utilisateurs de Windows peuvent exécuter `go-web.bat` pour démarrer WebUI, tandis que les utilisateurs de macOS peuvent exécuter `sh ./run.sh`.

|

| 131 |

-

|

| 132 |

-

## Compatibilité ROCm pour les cartes AMD (seulement Linux)

|

| 133 |

-

Installez tous les pilotes décrits [ici](https://rocm.docs.amd.com/en/latest/deploy/linux/os-native/install.html).

|

| 134 |

-

|

| 135 |

-

Sur Arch utilisez pacman pour installer le pilote:

|

| 136 |

-

````

|

| 137 |

-

pacman -S rocm-hip-sdk rocm-opencl-sdk

|

| 138 |

-

````

|

| 139 |

-

|

| 140 |

-

Vous devrez peut-être créer ces variables d'environnement (par exemple avec RX6700XT):

|

| 141 |

-

````

|

| 142 |

-

export ROCM_PATH=/opt/rocm

|

| 143 |

-

export HSA_OVERRIDE_GFX_VERSION=10.3.0

|

| 144 |

-

````

|

| 145 |

-

Assurez-vous que votre utilisateur est dans les groupes `render` et `video`:

|

| 146 |

-

````

|

| 147 |

-

sudo usermod -aG render $USERNAME

|

| 148 |

-

sudo usermod -aG video $USERNAME

|

| 149 |

-